GeminiでBANされると、GmailやGoogle Driveなど、Google関連のサービスが全て使えなくなる

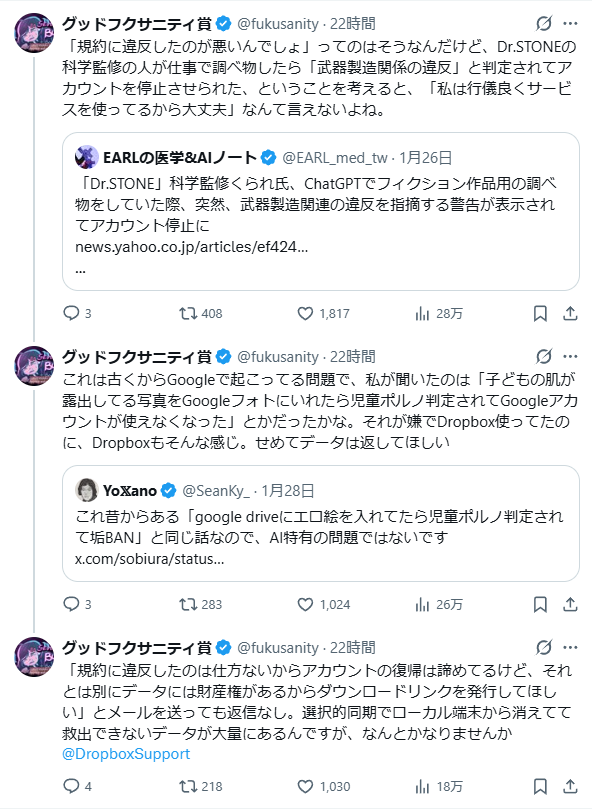

最近、こんな情報がXでバズっているのを目撃した。

元のニュースがこちら↓↓↓

これは他人事ではないかも・・・と、少しドキッとした。

いや、別にやましい事をしているわけではない。

ただ今回のケースだと、漫画のストーリーを書くために「戦車の作り方」や「武器の製造」に関する情報を質問していたことでAI側の安全対策に抵触し、危険人物と判断されてしまったのが原因。あくまでフィクションとして、「納得感のある説明」を聞こうとしただけ。つまり、誤BANである。

こうした誤BANによって、GeminiだけでなくGmailなどの生活や仕事に必須のサービスが、ある日突然使えなくなる・・・これは結構ヤバい。(そして同時に、いつの間にか自分が、Google様に深く依存していたことを実感)

さらにもう一つ怖いポストがあって、DropboxがBANされたというもの。

保存していた写真などのデータが原因で、誤BANされたというもの。

今はAIでいろんな文章や画像、動画がすぐ作れてしまう時代。興味本位でたまたま作れてしまった、規約違反と認識されるかもしれないコンテンツをGoogle Driveに保存してしまって・・・ということが、誰にでも起こり得る。

ということで、何か対策はできないかを考えてみた。

考えるポイントは2つ。「データの保存場所」と「AIとの付き合い方」である。

データ保存場所の分散:アカウントではなく「思想」で分ける

まず思いつくのは「Googleアカウントを2つ作る」という対策。

しかし、これはどうやら危ないらしい。Googleは、アカウントそのものよりも「行動パターン」や「端末情報」でユーザーを認識している。つまり、メイン垢とサブ垢で同じような振る舞いをしていれば、共倒れするリスクは消えない。

むしろ「グレーなデータを逃がすためのサブ垢はBAN回避の意図がある」として、逆効果になる恐れもある。

- Circumvent safeguards(安全措置の回避)

- Multiple accounts to evade enforcement(規制・制裁を回避するために複数のアカウントを使う行為)

したがって、有効な手段はアカウントを増やすことではなく、

- ローカルに保存する

- 運営元の思想が異なるクラウドに保存する

のいずれかである。

ローカルに保存する

万が一、クラウド上のあらゆる契約が解除されても、自分のPCや外付けSSDなどに保存されたデータは、それらが壊れない限り手元に残る。原始的な方法だが、どうしても外部に干渉されたくないデータがある場合は、この方法で物理的に守るしかない。

運営元の思想が異なるクラウドに保存する

クラウドは、Google DriveやOneDrive、iCloudなど代表的なものに加え、Dropboxなどのストレージサービスもあるが、いずれも検閲リスクがゼロではない。保存に加え、共有などの作業性はいいが、完全に安全な避難場所とは言えない。

そこで見つけたクラウドサービスの一つが、Proton Drive。

こちらは、GoogleやMicrosoftとは根本的に思想が異なる「ゼロ知識証明(Zero Knowledge)」を採用したクラウドストレージ。詳しいことは筆者もよくわかっていないのだが、仕組み上、運営側ですらユーザーのデータの中身を見ることができないとのこと。つまり、AIによる自動スキャンや誤判定の発生もしようがない場所といえる。

プライベートな写真、創作活動のネタなど、誤解されやすい資料はここに隔離するのが安全。

あくまで「潔白だが、AIに不当に疑われるリスク」を排除するために使うことを想定しており、違法なものを隠すためではありません。

なお、費用はこんな感じである↓↓↓

ちなみにDropboxと比較すると、共有や検索、プレビュー機能などの作業面においてはDropboxが便利。Proton Driveは、「使い勝手は悪いけど中身が見られない金庫」という感じ。

AIとの付き合い方:「先生」になってもらい「手先」にしない

次に、Geminiなどの生成AI利用におけるBANリスク対策。

正直に言うと、これはまだベストな回答が出ていない。

まず、AIの利用において最も危険なのは、ポリシー違反ギリギリの質問を繰り返す「Policy Evasion(安全措置の回避行動)」と判定されること。

これを避けるためには、AIを「先生・解説者」というポジションに固定し、「役割」を限定するのが、一つの方法である。

⭕ 安全な質問:「〇〇という事象の歴史的背景は?」「〇〇が危険とされる倫理的な理由は?」

❌ 危険な質問:「〇〇の具体的な製造方法は?」「〇〇を回避する裏技は?」

「作り方」や「実行手順」を聞くと、AIは「こいつは実行しようとしている」と警戒レベルを上げる。一方で、概念や歴史、倫理的背景を聞く分には、学術的・教育的な文脈として処理されやすい。

Gensparkなどの外部ツールを使うのは有効か?

Gensparkなどの外部サービス経由でGeminiを使えば安全かというと、そうでもないらしい。

仮にGoogleのアカウントでログインしていれば、その評価はGoogleに紐づく。API経由であっても「危険な使い方をするユーザー」という烙印は、経路に関係なく押されてしまう。外部ツールはあくまでUIの違いであり、BAN避けにはなり得ないと考えた方が無難である。

まとめ

ということで、現状筆者が考え得るBANリスク対策の結論は、以下の2点。

- 保存場所:Google一極集中をやめ、プライバシー重視のクラウド(Proton等)と物理ストレージへ分散する。

- AI利用:AIに際どい「手順」を聞かず、「概念」の整理に徹してもらう。

なお、「自分は何も悪いことをしていない」という主張は、アカウントが停止された後では聞き入れられないことが多いので、あまり期待しない方がいい。

平時のうちに、デジタルな生活基盤を「誤判定すら起こり得ない構造」へと作り替えておくこと。

それが、今後の時代におけるリテラシーかもしれない。